Os grandes modelos de linguagem (Claude Sonnet, GPT, Gemini etc.) não armazenam memória de forma inerente. Sempre que enviamos uma nova mensagem, eles não fazem ideia de quem somos ou sobre o que conversamos anteriormente.

Na prática, ferramentas de IA, como o ChatGPT ou o Claude usam o conceito de contexto para simular uma memória de curto prazo, permitindo que os modelos relembrem de informações anteriores.

O que é contexto?

O contexto é um apanhado de informações relevantes dentro de uma “conversa” com um modelo de IA. Em modelos multimodais, essas informações podem ser texto, imagem, áudio, documentos etc., e se originam de:

- mensagens anteriores enviadas pelo usuário;

- respostas anteriores devolvidas pelo modelo;

- arquivos explicitamente adicionados na conversa;

- instruções personalizadas definidas pelo usuário;

- prompts fixos definidos por ferramentas de IA (Claude Code, Codex etc.);

- informações de ambiente (data e hora atuais, localização aproximada etc.).

O contexto é reavaliado e enviado ao modelo de IA juntamente a cada nova mensagem e permite que ele relembre o que foi conversado dentro de uma sessão.

É como uma pessoa em uma reunião anotando os pontos mais importantes em uma folha de papel para poder relembrar depois.

O que é janela de contexto?

Continuando com a analogia, perceba que existe um limite na quantidade de informações que podem ser escritas na folha. No caso dos modelos de IA, esse limite também existe e é chamado de janela de contexto.

A janela de contexto é medida em tokens, e afeta a forma como interagimos com modelos de IA, uma vez que, quando o limite é atingido, algumas informações são cortadas do contexto ou resumidas (compressão) e, como consequência, os resultados podem ficar menos precisos.

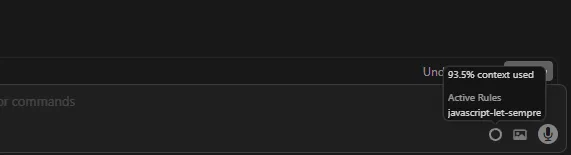

Ferramentas como o Claude Code ou o Cursor exibem indicadores de uso do contexto para a sessão atual, o que ajuda a gerenciar a evolução do contexto.

A prática de otimizar as informações que ficam disponíveis como contexto para que os modelos de IA produzam resultados satisfatórios é chamada de Context Engineering.

Conclusão

Modelos de IA não possuem uma memória própria, sendo necessário alimentá-los com informações de contexto.

A janela de contexto é o nome dado ao tamanho limite de contexto que um modelo consegue processar.